Học máy có thể nhìn thấy: Hiểu về mạng thần kinh từ nền tảng

2020-05-04

Về học máyi9bet.com nhận 100k, có một câu đùa cổ xưa:

Machine learning is like highschool sex. Everyone says they do it789 Club, nobody really does, and no one knows what it actually is. [1]

Ý nghĩa dịch sang tiếng Việt:

Học máy giống như việc hẹn hò của học sinh trung học. Mọi người đều nói rằng họ đã từng trải qua789 Club, nhưng thực tế là không ai thực sự làm được điều đó, và cũng không ai thực sự hiểu nó thật sự là gì. Nó giống như một chủ đề bí ẩn mà tất cả mọi người đều bàn tán xôn xao, nhưng khi bạn cố gắng tìm hiểu sâu hơn, mọi thứ lại trở nên mơ hồ và khó nắm bắt. Có lẽ vì thế mà nó càng trở thành một phần không thể thiếu trong các cuộc trò chuyện giữa những người đam mê công nghệ.

tai nghe mắt thấy

Bài viết này sẽ không xuất hiện bất kỳ công thức nàoi9bet.com nhận 100k, hy vọng những người không chuyên cũng có thể hiểu được. Hy vọng như vậy ^-^

Mạng thần kinh đơn giản nhất

Trong lĩnh vực nhận diện hình ảnh hay xử lý ngôn ngữ tự nhiên hiện nay789 Club, các mạng thần kinh sâu đang phát triển những cấu trúc mạng vô cùng phức tạp. Với hàng chục lớp mạng và hàng trăm nghìn, thậm chí hàng triệu tham số mô hình, việc hiểu rõ về chúng thực sự là một thách thức lớn. Hơn nữa, việc chạy và tính toán trên những mạng này cũng đòi hỏi nguồn lực mạnh mẽ và hệ thống phần cứng tiên tiến để có thể hoạt động hiệu quả. Hãy tưởng tượng rằng mỗi tham số trong mạng như một tế bào nhỏ trong cơ thể, và khi kết nối với nhau, chúng tạo thành một hệ thống cực kỳ phức tạp, gần giống như một mê cung khổng lồ. Để giải mã mê cung này, không chỉ cần kiến thức chuyên môn sâu rộng mà còn phải có công cụ và tài nguyên đủ mạnh để xử lý khối lượng dữ liệu khổng lồ mà nó tạo ra. Điều này không chỉ là bài toán cho các nhà nghiên cứu mà còn đặt ra thách thức lớn cho cả ngành công nghiệp và hệ thống máy tính hiện đại.

Do đói9bet.com nhận 100k, chúng ta sẽ bắt đầu từ đơn giản đến phức tạp, trước tiên xem xét trường hợp đơn giản nhất.

phân loại nhị phân

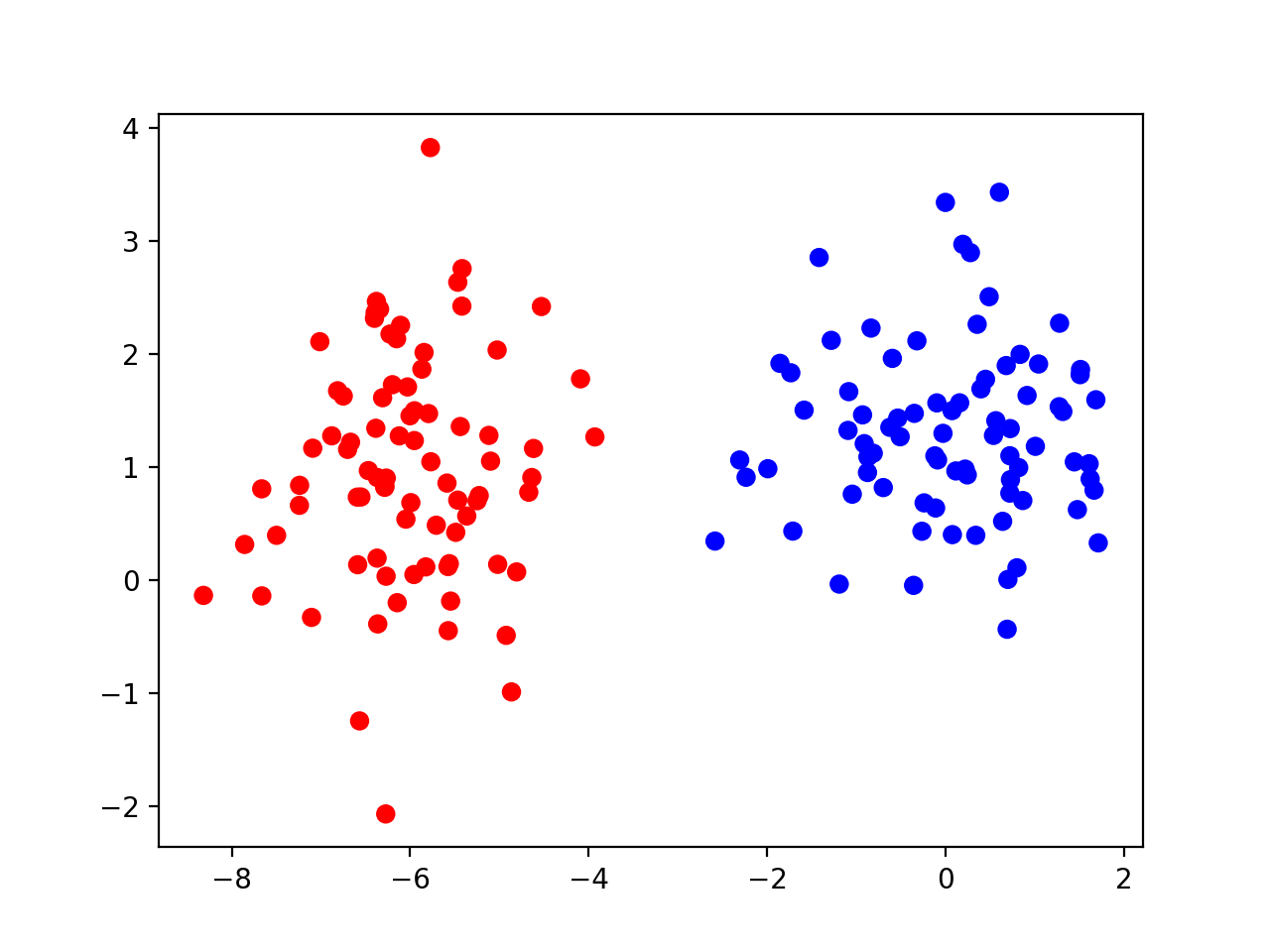

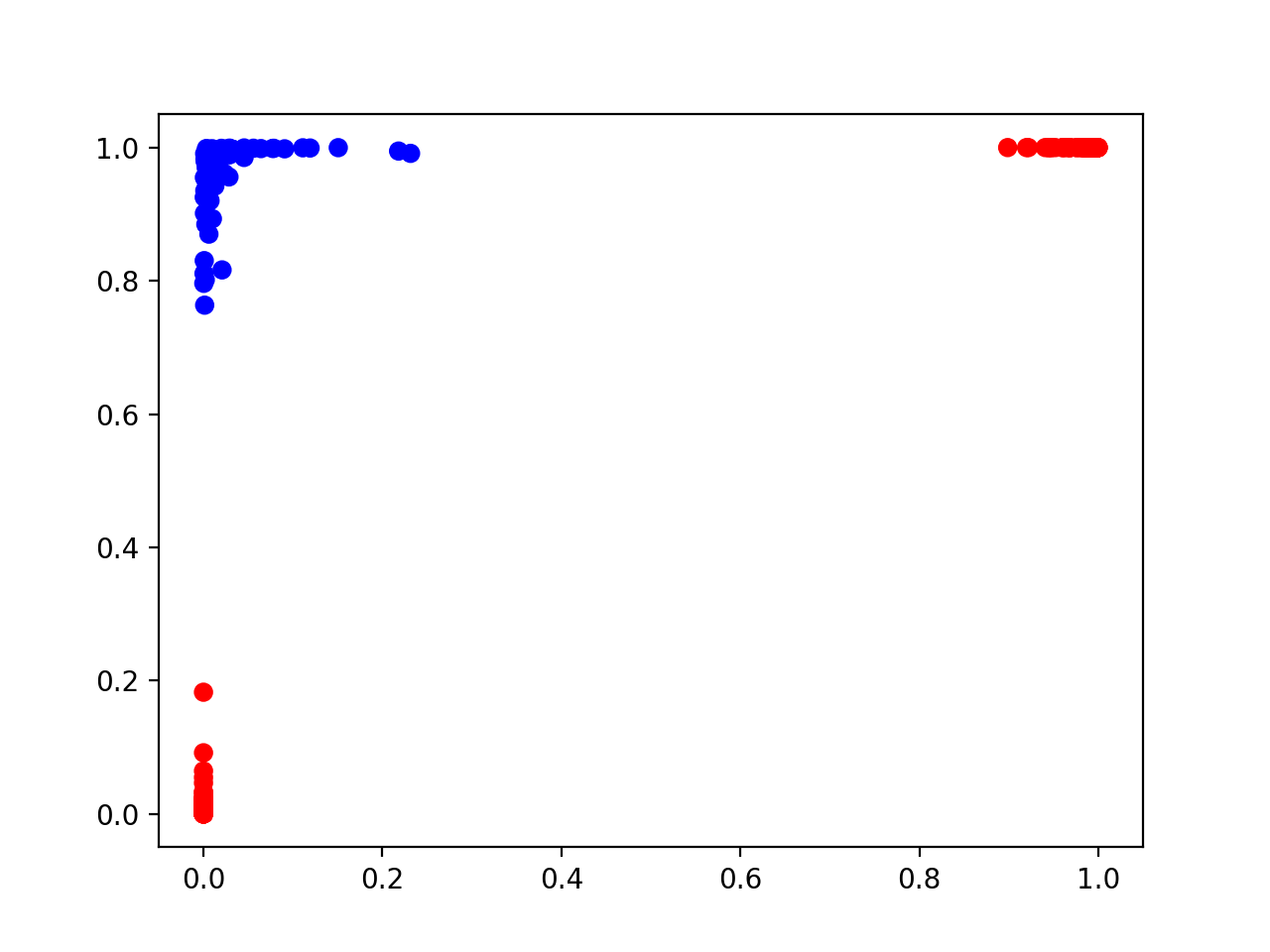

Hình ảnh phía trên cho thấy tổng cộng 160 điểm (bao gồm cả điểm màu đỏ và xanh dương)789 Club, mỗi điểm đại diện cho một mẫu dữ liệu. Rõ ràng, mỗi mẫu dữ liệu này bao gồm 2 đặc trưng, nhờ đó mỗi mẫu có thể được biểu diễn dưới dạng một điểm trong hệ tọa độ hai chiều. Các điểm màu đỏ biểu thị rằng mẫu dữ liệu đó thuộc phân loại thứ nhất, trong khi các điểm màu xanh dương lại chỉ ra rằng mẫu dữ liệu đó thuộc phân loại thứ hai. Ngoài ra, việc sử dụng hai màu sắc khác nhau giúp người quan sát dễ dàng nhận biết sự phân chia giữa hai nhóm dữ liệu trên mặt phẳng tọa độ.

Bài toán phân loại nhị phân có thể được hiểu như sau: tạo ra một mô hình phân loại để chia tập dữ liệu huấn luyện gồm 160 mẫu trong hình trên thành hai nhóm theo từng lớp tương ứng. Tuy nhiêni9bet.com nhận 100k, cần lưu ý rằng cách diễn đạt này không thực sự chính xác. Những mẫu dữ liệu trong hình chỉ mang tính chất huấn luyện, nhưng mô hình thu được cần phải có khả năng phân loại các mẫu khác bên ngoài tập dữ liệu này (mặc dù ở đây chúng ta chưa đề cập đến vấn đề này và có thể tạm thời bỏ qua chi tiết này).

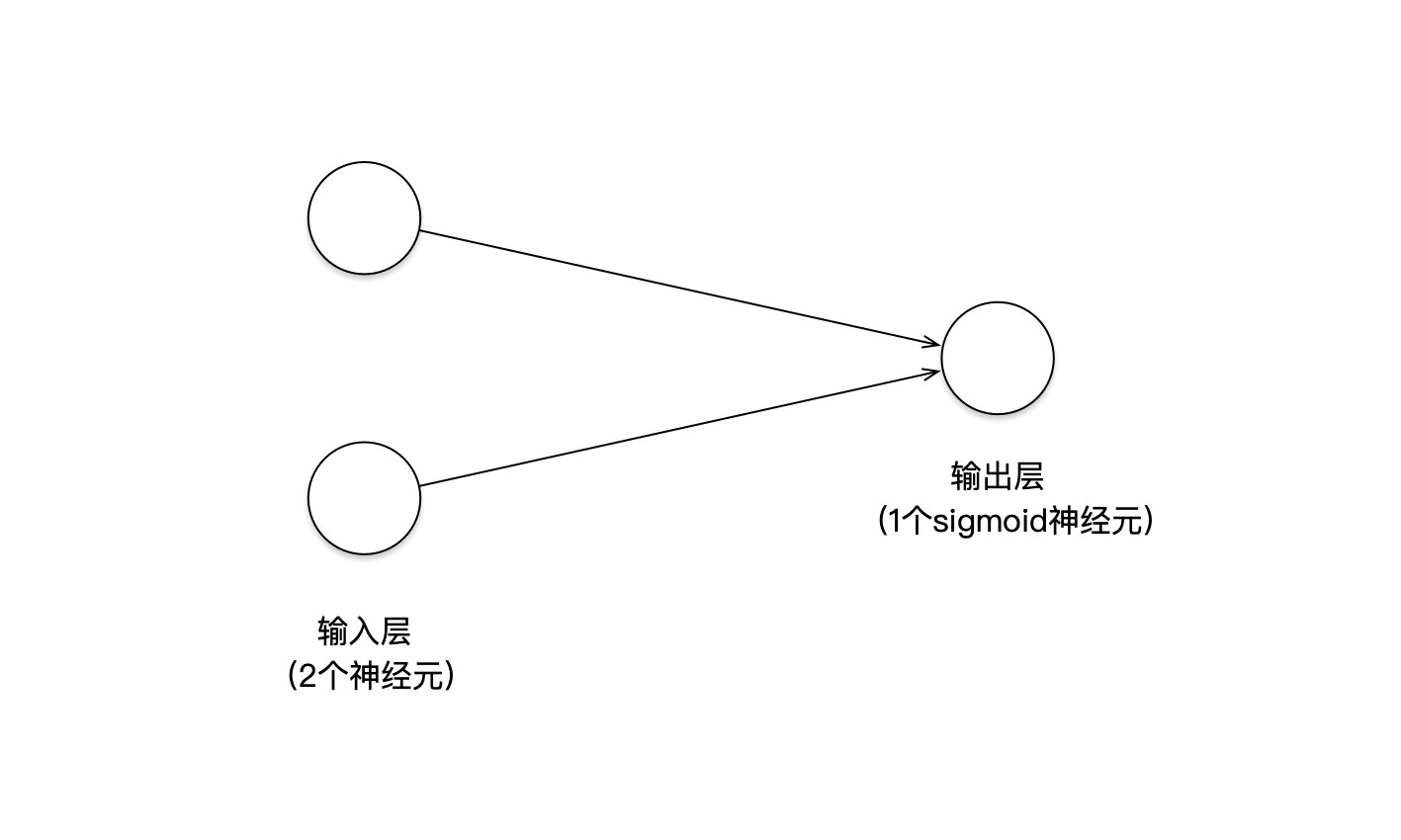

Để thực hiện nhiệm vụ phân loại nhị phân này789 Club, chúng ta có rất nhiều mô hình học máy để lựa chọn. Tuy nhiên, mục tiêu hiện tại của chúng ta là nghiên cứu về mạng nơ-ron, vì vậy chúng ta có thể thiết kế một mạng nơ-ron đơn giản nhất để giải quyết vấn đề phân loại này. Mô hình như sau: (Ở đây có thể thêm mô tả chi tiết về cấu trúc của mạng nơ-ron nếu cần thiết, nhưng theo yêu cầu không được sử dụng ký tự khác ngoài tiếng Việt nên sẽ giữ nguyên ý nghĩa mà không thêm bất kỳ ký tự nào khác)

Mạng thần kinh này gần như không thể đơn giản hơnbầu cua, chỉ có một lớp đầu vào và một lớp đầu ra, tổng cộng chỉ có 3 nơ-ron.

Dựa trên phân tích toán học đơn giản789 Club, ta dễ dàng nhận ra rằng mô hình mạng nơ-ron chỉ có 2 lớp này thực chất tương đương với mô hình LR (logistic regression) trong học máy truyền thống. Điều đó có nghĩa là đây là một bộ phân loại tuyến tính, và việc đào tạo nó cũng giống như tìm kiếm một đường thẳng trong mặt phẳng tọa độ hai chiều để phân chia các điểm màu đỏ và điểm màu xanh. Tuy nhiên, cần lưu ý rằng mặc dù về mặt lý thuyết chúng có thể biểu diễn cùng một cách tiếp cận, nhưng việc sử dụng mạng nơ-ron cung cấp khả năng linh hoạt hơn trong việc mở rộng mô hình hoặc điều chỉnh các tham số phức tạp hơn trong tương lai.

Dựa trên sự phân bố của các điểm màu đỏ và điểm màu xanhbầu cua, chúng ta có thể dễ dàng nhận thấy rằng việc tìm ra hoặc học được một đường thẳng như thế này là khá đơn giản. Trên thực tế, mạng thần kinh nhân tạo đơn giản được hiển thị trong hình trên, sau quá trình huấn luyện, có khả năng đạt được độ chính xác phân loại (accuracy) lên tới 100%. Đây là minh chứng rõ ràng cho khả năng học hỏi mạnh mẽ của mô hình này khi nó có thể phân biệt hoàn hảo giữa các tập dữ liệu khác nhau chỉ bằng cách điều chỉnh các trọng số và ngưỡng phù hợp.

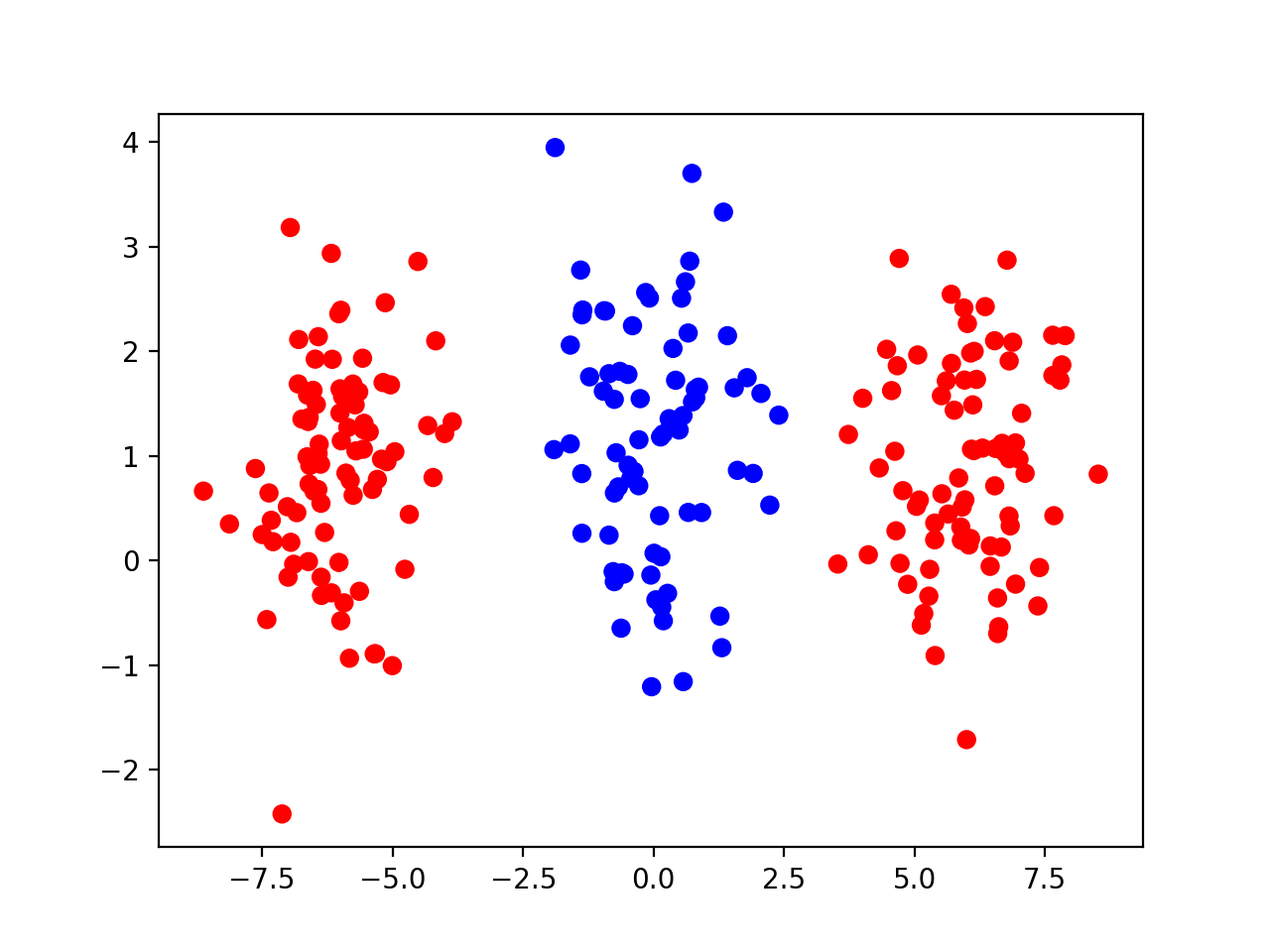

Giờ đây789 Club, giả sử tập dữ liệu của chúng ta trở thành hình dạng bên dưới (các điểm đỏ chia thành hai cụm, nằm ở hai bên các điểm xanh):

Nếu chúng ta tiếp tục sử dụng mạng neural có hai lớp như trước đây để vẽ một đường thẳng nhằm phân chia các điểm màu đỏ và điểm màu xanhi9bet.com nhận 100k, điều đó chắc chắn sẽ không thể thực hiện được. Chúng ta có thể nói rằng tập dữ liệu này hiện tại đã vượt ra khỏi phạm vi có thể phân chia tuyến tính nữa rồi. Thực tế cho thấy, đối với tập dữ liệu mới này, bất kể bạn huấn luyện mạng neural hai lớp kia như thế nào, mức độ chính xác phân loại mà nó đạt được sẽ chỉ ở khoảng 60% đến 70%. Điều này cho thấy rằng để xử lý tập dữ liệu phức tạp hơn, chúng ta cần một mô hình sâu hơn hoặc có kiến trúc khác biệt.

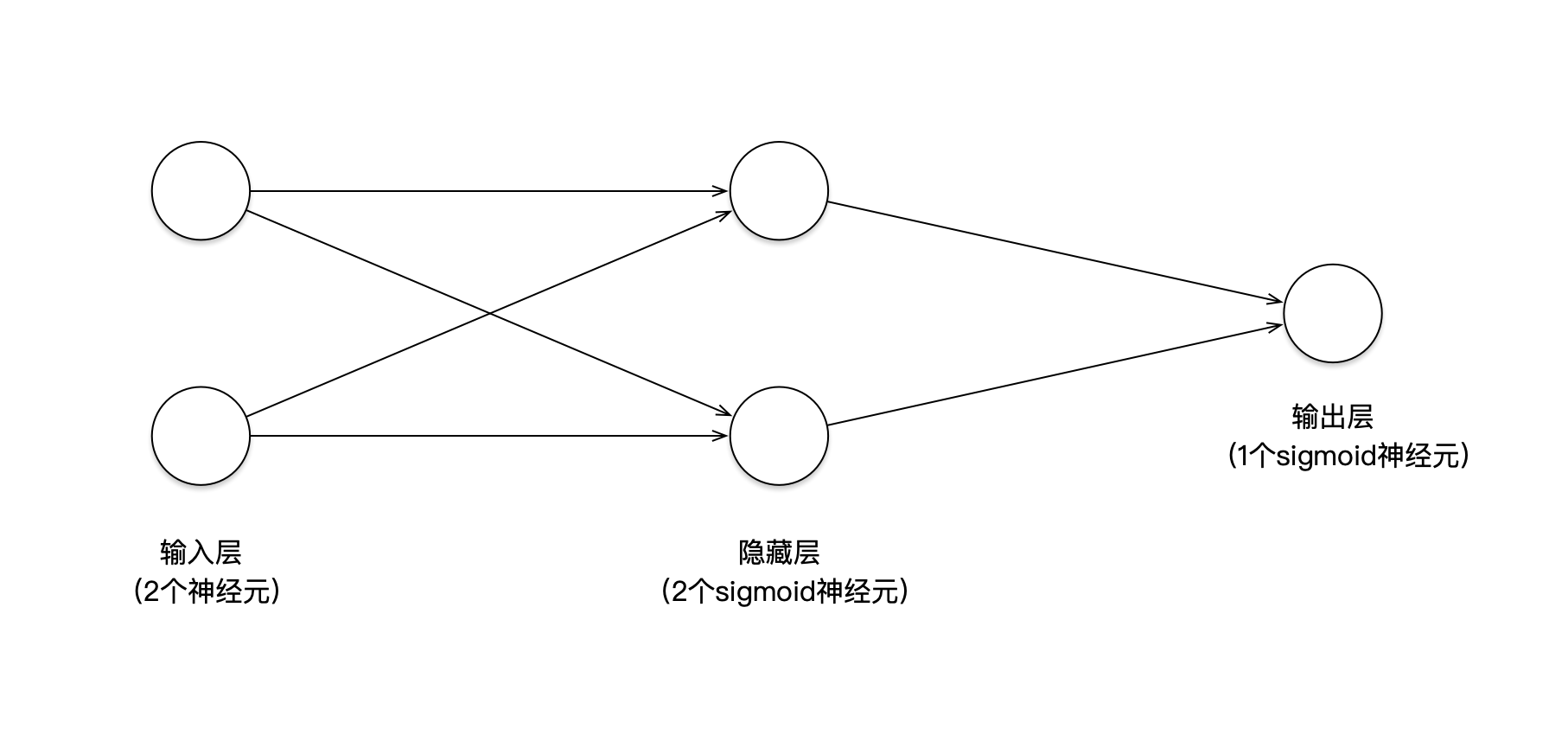

Để tăng độ chính xác trong việc phân loạii9bet.com nhận 100k, ý tưởng trực quan nhất có lẽ là vẽ một đường cong, nhờ đó có thể phân tách hoàn toàn các điểm màu đỏ và điểm màu xanh. Điều này đồng nghĩa với việc cần thực hiện một biến đổi phi tuyến tính (non-linear transformation) đối với dữ liệu đầu vào ban đầu. Trong mạng nơ-ron, chúng ta có thể thực hiện biến đổi này bằng cách thêm một lớp ẩn (hidden layer). Mạng nơ-ron đã được điều chỉnh sẽ như hình dưới đây: [Trong phần này, bạn có thể bổ sung thêm thông tin về cấu trúc của mạng nơ-ron hoặc cách hoạt động của lớp ẩn nếu muốn làm phong phú nội dung]

Chúng ta nhận thấy rằng789 Club, sau khi được điều chỉnh, mạng nơ-ron đã bổ sung thêm một lớp ẩn chứa hai neuron sigmoid; đồng thời, lớp đầu vào và lớp ẩn này có mối liên kết toàn phần. Thực tế cho thấy, khi chúng ta huấn luyện lại mạng nơ-ron với lớp ẩn mới này, độ chính xác trong việc phân loại lại đạt mức 100% (hoặc rất gần với 100%). Điều đó xảy ra là do gì? Có lẽ vì việc thêm lớp ẩn giúp mạng có khả năng biểu diễn các tính chất phức tạp hơn của dữ liệu, từ đó cải thiện hiệu suất học tập và dự đoán. Một lớp ẩn bổ sung cũng có thể tạo ra các đại diện đặc trưng tốt hơn, giảm thiểu tối đa sai số khi thực hiện phân loại.

Chúng ta có thể hình dung về việc tính toán của mạng nơ-ron như sau: mỗi khi dữ liệu đi qua một lớp trong mạngi9bet.com nhận 100k, nó thực chất là đang trải qua một sự biến đổi không gian mẫu (bao gồm tất cả các điểm dữ liệu trong đó). Nói cách khác, dữ liệu đầu vào, khi đi qua tầng ẩn, sẽ được biến đổi theo một cách nhất định. Và do tầng ẩn sử dụng hàm kích hoạt sigmoid, nên sự biến đổi này chính là một dạng biến đổi phi tuyến tính. Điều này cho phép mạng học hỏi và biểu diễn những mối quan hệ phức tạp hơn trong dữ liệu.

Vậy789 Club, một câu hỏi tự nhiên là sau khi thực hiện biến đổi phi tuyến tính qua lớp ẩn, mẫu dữ liệu đầu vào sẽ thay đổi ra sao? Tiếp theo, chúng ta hãy xem biểu diễn của hai nơ-ron trong lớp ẩn được thể hiện như thế nào trong hình dưới đây:

có thể phân tuyến tính

Từ hình ảnh đầu ra của lớp ẩnbầu cua, chúng ta còn có thể phát hiện ra một số chi tiết:

- Tất cả các tọa độ dữ liệu (bất kể là trục X hay trục Y) đều nằm trong khoảng từ 0 đến 1. Điều này xuất phát từ đặc tính của hàm kích hoạt sigmoidi9bet.com nhận 100k, vốn có khả năng biến đổi toàn bộ tập hợp số thực thành giá trị nằm trong khoảng giữa 0 và 1. Hàm sigmoid thường được sử dụng trong các mạng nơ-ron nhân tạo để giới hạn đầu ra vào một phạm vi cụ thể, giúp việc huấn luyện mô hình trở nên ổn định hơn. Khi các giá trị đầu vào trải qua hàm này, chúng sẽ bị ép lại gần hơn về phía khoảng (0,1), điều này không chỉ giúp kiểm soát dữ liệu mà còn làm tăng hiệu quả tính toán trong nhiều bài toán.

- Chúng tôi nhận thấy rằng tất cả các dữ liệu dường như tập trung ở một góc nào đó. Điều này không phải là do ngẫu nhiên mà xuất phát từ đặc tính của hàm kích hoạt sigmoid. Khi các nơ-ron sigmoid được đào tạo đủ sâu và đạt đến trạng thái "bão hòa"789 Club, chúng thường sẽ cho ra giá trị gần 0 hoặc 1, rất hiếm khi trả về một giá trị nằm ở giữa khoảng (0,1). Hàm sigmoid có xu hướng làm cho đầu ra của nó cực kỳ rõ ràng trong hai cực, khiến việc dự đoán trở nên ổn định hơn nhưng cũng khó điều chỉnh hơn trong những trường hợp phức tạp.

tách biệt tuyến tính

Rõ ràngbầu cua, ví dụ này rất đơn giản, chỉ là cấu trúc mạng neural cơ bản nhất. Nhưng ngay cả khi nói đến các mạng neural phức tạp hơn, nguyên lý vẫn tương tự. Mỗi khi mẫu dữ liệu đi qua một lớp của mạng neural, nó sẽ trở nên "dễ phân biệt" hơn so với trước. Bây giờ chúng ta hãy cùng xem xét một ví dụ phức tạp hơn chút. Hãy tưởng tượng rằng mỗi lớp trong mạng neural như một bộ lọc đặc biệt, làm nổi bật những yếu tố quan trọng và loại bỏ những nhiễu không cần thiết. Khi dữ liệu di chuyển từ lớp này sang lớp khác, nó dần dần được biến đổi thành một dạng mà máy móc có thể hiểu rõ hơn. Điều này giống như việc bạn đang làm sạch một bức tranh bị mờ, từng bước giúp cho hình ảnh trở nên sắc nét và dễ nhận diện hơn. Tiếp theo, chúng ta sẽ khám phá một mạng neural có nhiều lớp hơn và khả năng xử lý dữ liệu lớn hơn, nhưng đừng lo lắng - dù nó có phức tạp thế nào đi chăng nữa, cách hoạt động vẫn dựa trên nguyên tắc cơ bản mà chúng ta vừa tìm hiểu.

Nhận diện chữ số viết tay MNIST

nhận diện chữ số viết tay

Xin chào thế giới

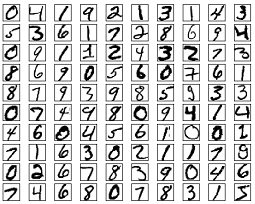

Trong tập dữ liệu MNISTi9bet.com nhận 100k, có tổng cộng 70.000 hình ảnh chữ số viết tay. Chúng giống như hình dưới đây:

Mỗi hình ảnh trong số đó có kích thước 28 pixel x 28 pixel và chỉ tồn tại dưới dạng đen trắng. Trong đói9bet.com nhận 100k, mỗi pixel được biểu thị bằng một giá trị độ xám nằm trong khoảng từ 0 đến 255, nơi 0 tượng trưng cho màu đen hoàn toàn và 255 đại diện cho màu trắng thuần khiết.

Bài toán nhận diện chữ số trong tập dữ liệu MNIST là như sau: bạn sẽ nhận được một hình ảnh kích thước 28 pixel × 28 pixelbầu cua, và nhiệm vụ của bạn là viết một chương trình để xác định chính xác hình đó thuộc chữ số nào, từ 0 cho đến 9. Đây là một thử thách thú vị đòi hỏi thuật toán phải học cách phân biệt các nét bút, đường cong và các đặc điểm đặc trưng của từng chữ số chỉ bằng cách phân tích hình ảnh đơn thuần.

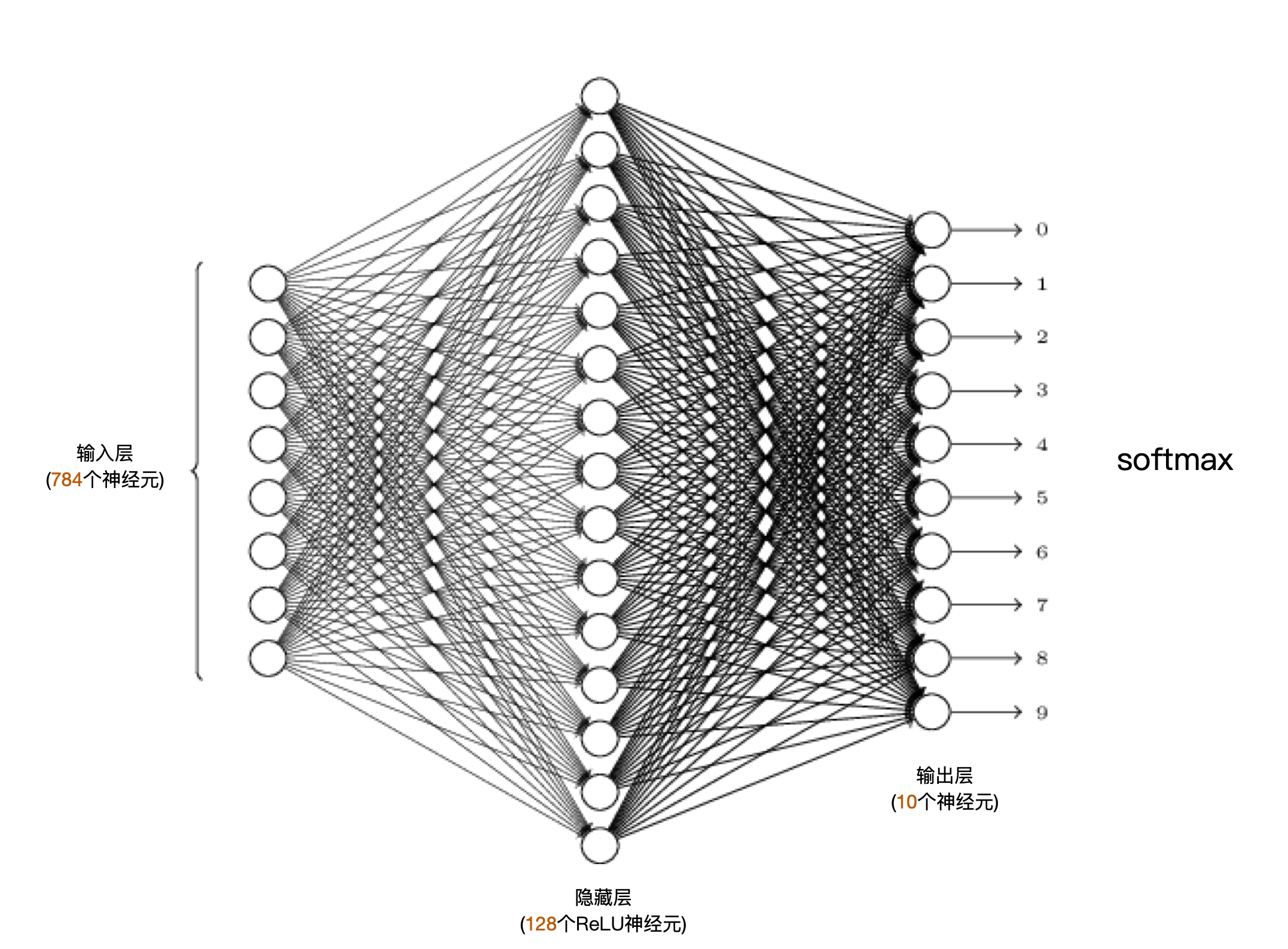

Về vấn đề nàyi9bet.com nhận 100k, thành tích tốt nhất trong lịch sử đạt được mức độ nhận diện lên đến 99,79%. Phương án trước đó đã áp dụng mạng nơ-ron convolutional (CNN), nhưng ở đây chúng tôi không muốn làm vấn đề trở nên phức tạp hơn cần thiết. Vì vậy, thay vào đó, chúng tôi quyết định sử dụng mạng nơ-ron toàn phần thông thường để giải quyết bài toán. Kết cấu mạng mà chúng tôi đang áp dụng như sau: Chúng tôi bắt đầu với một lớp tiền xử lý dữ liệu để đảm bảo tính nhất quán và giảm nhiễu. Tiếp theo là một loạt các lớp ẩn, mỗi lớp được thiết kế để tinh chỉnh thêm sự phân biệt của các đặc trưng. Sau cùng, lớp cuối cùng sẽ đưa ra dự đoán cuối cùng dựa trên các giá trị mà các lớp trước đó đã học được. Với phương pháp tiếp cận đơn giản này, chúng tôi kỳ vọng có thể đạt được kết quả khả quan mà vẫn duy trì tính hiệu quả và dễ triển khai.

Đầu vào và đầu ra của mạng thần kinh này được định nghĩa như sau:

- Mỗi lần bạn nhập một hình ảnh. Giá trị độ xám của từng pixel trong hình ảnh sẽ được chia cho 255 để thu được giá trị chuẩn hóa nằm trong khoảng [0789 Club,1]. Sau đó, các giá trị này sẽ được truyền vào từng nơ-ron ở lớp đầu vào. Nói cách khác, lớp đầu vào có 784 nơ-ron, tương ứng với tổng số pixel của một hình ảnh có kích thước 28x28, nghĩa là 784 pixel. Điều này giúp mạng lưới thần kinh dễ dàng xử lý và học hỏi từ hình ảnh mà không gặp khó khăn về quy mô dữ liệu.

- Trong lớp đầu rabầu cua, có tổng cộng 10 nơ-ron, và mỗi nơ-ron sẽ đại diện cho một trong các chữ số từ 0 đến 9. Khi nào một nơ-ron có giá trị đầu ra lớn nhất, chúng ta có thể kết luận rằng kết quả dự đoán chính là chữ số mà nơ-ron đó biểu diễn. Ngoài ra, sau khi áp dụng hàm softmax lên 10 giá trị đầu ra này, chúng ta sẽ nhận được xác suất của hình ảnh hiện tại thuộc từng chữ số từ 0 đến 9. Điều này giúp việc phân loại trở nên rõ ràng hơn, vì các giá trị sau khi xử lý softmax sẽ phản ánh chính xác xác suất tương ứng với từng khả năng.

Sau khi đào tạo mạng thần kinh nàybầu cua, bạn có thể dễ dàng đạt được tỷ lệ nhận diện chính xác khoảng 98%. Đối với mạng thần kinh rộng hơn này, liệu chúng ta vẫn có thể áp dụng phương pháp trước đây để vẽ biểu đồ trực quan cho nó không? Thêm vào đó, việc điều chỉnh các tham số của mạng thần kinh rộng hơn sẽ đòi hỏi sự cẩn trọng cao hơn. Vì nó có nhiều nơ-ron và kết nối hơn, nên việc theo dõi quá trình học tập và hiệu suất trở nên phức tạp hơn. Tuy nhiên, nếu chúng ta tìm ra cách điều chỉnh hợp lý, khả năng trực quan hóa vẫn có thể thực hiện được bằng cách sử dụng các kỹ thuật phân tích dữ liệu mới nhất.

Giảm chiều

Trong phần trước789 Club, mạng thần kinh đơn giản mà chúng ta vừa xây dựng có lớp đầu vào và lớp ẩn chỉ gồm 2 nơ-ron, do đó việc biểu diễn chúng trên một mặt phẳng tọa độ hai chiều là khá dễ dàng. Tuy nhiên, khi đến với mạng này dành cho tập dữ liệu MNIST, mọi thứ trở nên phức tạp hơn nhiều. Khi cố gắng vẽ hình ảnh của lớp đầu vào, chúng ta phát hiện ra rằng nó có tới 784 chiều! Điều này khiến việc trực quan hóa trở nên vô cùng khó khăn, vì chúng ta không thể trực tiếp nhìn thấy hoặc tưởng tượng được không gian có đến 784 chiều như vậy. Đây chính là một thách thức lớn trong việc phân tích và hiểu sâu về hoạt động của mạng thần kinh khi làm việc với dữ liệu phức tạp như hình ảnh số.

Làm thế nào để biểu diễn một vector đặc trưng có kích thước 784 chiều dưới dạng đồ họa? Điều này liên quan đến vấn đề visualization của dữ liệu cao chiều. Nói chungi9bet.com nhận 100k, não bộ con người chỉ có thể hiểu được không gian tối đa ba chiều; đối với các không gian trên ba chiều, chúng ta thường phải phụ thuộc vào tư duy trừu tượng. Tuy nhiên, để xử lý vấn đề này, các nhà khoa học đã phát triển nhiều kỹ thuật giảm chiều, chẳng hạn như PCA (Phân tích thành phần chính) hoặc t-SNE, giúp chúng ta thu nhỏ dữ liệu từ nhiều chiều xuống hai hoặc ba chiều mà vẫn giữ được bản chất của nó. Điều này cho phép chúng ta dễ dàng nhìn thấy cấu trúc tiềm ẩn trong dữ liệu thông qua các biểu đồ.

Chúng ta tưởng tượng một ví dụ đơn giản để cảm nhận mức độ khó khăn khi hiểu trực quan trong không gian cao chiều:

- Ban đầui9bet.com nhận 100k, trong một mặt phẳng (tức là không gian hai chiều), chúng ta có thể tìm thấy ba điểm mà khoảng cách giữa mỗi cặp điểm đều bằng nhau, và từ đó có thể tạo thành một tam giác đều. Trong khái niệm hình học, điều này khá quen thuộc vì chỉ cần xác định ba điểm như vậy, chúng ta đã có một cấu trúc cân đối hoàn hảo, với mỗi cạnh của tam giác có độ dài giống hệt nhau. Điều này mở ra nhiều khả năng thú vị để khám phá thêm về các mối liên hệ giữa hình học phẳng và các nguyên lý đối xứng.

- Trong một không gian ba chiềui9bet.com nhận 100k, chúng ta có thể tìm thấy bốn điểm mà khoảng cách giữa mỗi cặp điểm là như nhau, từ đó tạo thành một tứ diện đều. Mỗi mặt của tứ diện này là một tam giác đều, với ba cạnh có độ dài bằng nhau. Điều đặc biệt là sự cân đối và đối xứng trong cấu trúc này khiến nó trở thành một trong những hình dạng cơ bản và đẹp nhất trong hình học không gian.

- Bây giời9bet.com nhận 100k, chúng ta hãy tưởng tượng mình đang ở không gian bốn chiều. Theo lý thuyết, chúng ta có thể tìm thấy năm điểm mà khoảng cách giữa bất kỳ hai điểm nào cũng bằng nhau, và từ đó có thể tạo ra một hình dạng mà tạm thời chúng ta gọi là "ngũ diện thể". Hãy tiếp tục so sánh: cái mà chúng ta gọi là "ngũ diện thể" này, thực chất mỗi "mặt" của nó (tức là hình được tạo thành bởi bốn trong số năm điểm) không phải là một mặt thật sự, mà là một tứ diện đều. Cần lưu ý rằng khi đặt tên cho hình này là "ngũ diện thể", chúng ta đã gây ra sự hiểu lầm lớn, vì nó nghe giống như một đa diện đều trong không gian ba chiều. Tuy nhiên, nếu bạn có kiến thức về lịch sử toán học, bạn sẽ biết rằng hơn 2000 năm trước, Euclid đã chỉ ra trong cuốn *Nguyên lý Hình học* rằng không tồn tại ngũ diện thể trong không gian ba chiều (thực tế, trong không gian ba chiều chỉ có năm loại đa diện đều). Cũng cần nhấn mạnh thêm rằng việc gọi nó là "ngũ diện thể" mang tính chất tạm thời và chỉ mang ý nghĩa tham chiếu trong không gian bốn chiều. Nó khác hoàn toàn với các đa diện đều quen thuộc trong không gian ba chiều mà chúng ta thường gặp. Chính sự phức tạp này làm nổi bật sự đa dạng và thú vị của toán học, nơi mà những khái niệm tưởng chừng đơn giản lại có thể dẫn đến những khám phá sâu sắc và đầy thách thức.

Thôi được rồii9bet.com nhận 100k, nếu bạn vẫn có thể nắm bắt đoạn cuối cùng về không gian bốn chiều vừa rồi, điều đó chứng tỏ bạn đã đọc rất cẩn thận và đang suy nghĩ sâu sắc trong quá trình đọc đó. ^-^ Tuy nhiên, ngay cả không gian bốn chiều thôi cũng đã khiến người ta cảm thấy đau đầu rồi (vì chúng tuân theo logic nhưng lại khó tưởng tượng), huống chi là việc tưởng tượng về cấu trúc hình học của không gian có đến 784 chiều! Tưởng tượng về những thứ như vậy thực sự vượt xa khả năng thông thường của con người. Chúng ta chỉ có thể hiểu về nó thông qua toán học và lý thuyết, nhưng để hình dung ra một không gian như thế thì quả thực là một thử thách lớn. Có lẽ đó chính là lý do mà các nhà vật lý và nhà toán học luôn phải dựa vào công cụ trừu tượng để khám phá những điều kỳ diệu trong vũ trụ.

hiểu rõ hơn một cách trực giác

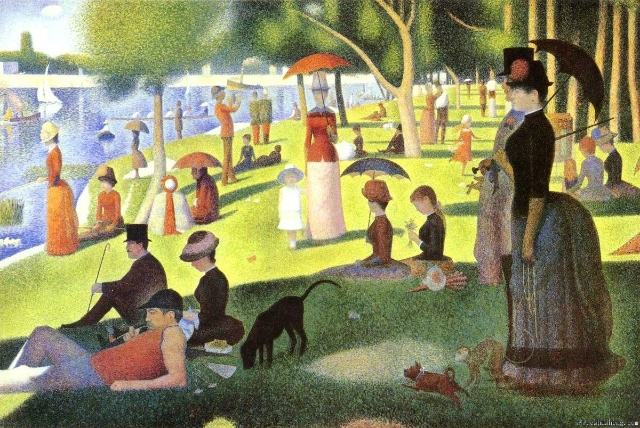

Việc hạ chiều không gian thực chất là một quy trình như thế nào? Hãy cùng quay ngược thời gian và nhìn lạibầu cua, chúng ta sẽ nhận ra rằng trong cuộc sống hàng ngày, mình đã từng gặp rất nhiều ví dụ về việc này. Ví dụ như bức ảnh dưới đây: Hãy tưởng tượng rằng bạn đang đứng trước một khung cảnh đầy màu sắc và chi tiết của một thành phố nhộn nhịp. Những tòa nhà cao vút, những con đường uốn lượn, và dòng người qua lại tạo nên một bản giao hưởng sống động. Nhưng khi chụp lại toàn cảnh này bằng một chiếc máy ảnh, tất cả mọi thứ đều được thu gọn vào trong một mặt phẳng hai chiều - từ ba chiều mà mắt thường nhìn thấy. Điều đó có nghĩa là chúng ta đã "hạ" bớt chiều không gian xuống còn hai chiều để lưu trữ thông tin một cách đơn giản hơn. Đó chính là khái niệm cơ bản về việc hạ chiều không gian: chuyển đổi dữ liệu từ không gian có nhiều chiều sang một không gian có ít chiều hơn, nhưng vẫn giữ nguyên hoặc gần như giữ nguyên ý nghĩa ban đầu. Một lần nữa, hãy cùng xem xét kỹ hình ảnh minh họa bên dưới để hiểu rõ hơn về cách hoạt động của quá trình này nhé!

Chiều Chủ Nhật tại Đảo Grande Jatte

Bây giờ chúng ta hãy xem thêm một ví dụ nữa:

Trong hìnhbầu cua, bên phải là một bản đồ thế giới dạng phẳng. Thực tế, bề mặt Trái Đất là một hình cầu trong không gian ba chiều, nhưng bản đồ thế giới trên đây đã cố gắng thể hiện toàn bộ hình cầu này lên một mặt phẳng hai chiều. Để thực hiện điều đó, rõ ràng các nhà vẽ bản đồ cần phải "làm phẳng" hình cầu và một số khu vực nhất định sẽ bị kéo giãn hoặc biến dạng. Chúng ta có thể tưởng tượng quá trình này như một loại ánh xạ: mỗi điểm trên bề mặt Trái Đất được ánh xạ thành một điểm cụ thể trên bản đồ phẳng. Tuy nhiên, không phải tất cả các điểm đều tuân theo cùng một mối quan hệ tuyến tính, do đó đây là một phép biến đổi phi tuyến tính. Hơn nữa, việc làm phẳng hình cầu không tránh khỏi những sai lệch đáng kể ở một số khu vực nhất định. Các khu vực gần cực thường bị nở rộng hơn rất nhiều so với thực tế, khiến chúng mất đi kích thước và tỷ lệ chính xác. Điều này cho thấy rằng dù bản đồ là một công cụ hữu ích để hiểu về địa lý, nó không hoàn toàn phản ánh đúng thực tế của bề mặt Trái Đất. Vì vậy, khi sử dụng bản đồ, chúng ta cần luôn nhớ rằng nó chỉ là một đại diện gần đúng, chứ không phải bản sao hoàn hảo của thế giới thực.

Trên đâybầu cua, dù là ví dụ về tác phẩm hội họa, hình ảnh, hay bản đồ thế giới dạng phẳng, tất cả đều liên quan đến việc giảm chiều từ ba chiều xuống hai chiều. Tuy nhiên, trong lĩnh vực học máy, chúng ta thường cần phải thực hiện quá trình giảm chiều từ các không gian có số chiều lớn hơn xuống ba hoặc hai chiều. Để đạt được điều này, con người đã phát triển nhiều phương pháp giảm chiều khác nhau. PCA (Phân tích thành phần chính) là một phương pháp giảm chiều tuyến tính; MDS (Chạy tỷ lệ đa chiều), t-SNE (Tối ưu lân cận hàng xóm phân bố theo t) lại là những phương pháp giảm chiều phi tuyến tính. PCA giúp chúng ta tìm ra các hướng quan trọng nhất để giữ lại nhiều thông tin nhất khi giảm chiều, trong khi đó MDS tập trung vào việc duy trì khoảng cách giữa các điểm dữ liệu trong không gian mới. Còn t-SNE nổi tiếng với khả năng sắp xếp dữ liệu phức tạp thành các cụm rõ ràng trong không gian hai hoặc ba chiều, đặc biệt hữu ích khi phân tích dữ liệu lớn và phức tạp. Mỗi phương pháp đều mang lại những lợi ích riêng tùy thuộc vào nhu cầu cụ thể của bài toán mà bạn đang giải quyết.

Phương pháp giảm chiều và trực quan hóa dựa trên đồ thị k gần hàng và mô hình cơ học

Những phương pháp giảm chiều đã được đề cập trước đóbầu cua, mỗi phương pháp đều có cách tiếp cận và trọng tâm riêng. Giải thích chi tiết về bất kỳ phương pháp nào cũng đòi hỏi một lượng lớn thời gian và không gian, vì vậy trong bài viết này chúng tôi sẽ không đi sâu vào từng chi tiết. Thay vào đó, với mục tiêu sắp tới của chúng ta là trực quan hóa một cách sinh động mạng nơ-ron mà phần trước đã giới thiệu về MNIST, chúng tôi sẽ sử dụng một phương pháp trực tiếp hơn và dễ hiểu hơn — một phương pháp dựa trên đồ thị hàng xóm gần nhất (k-NNG - k-Nearest Neighborhood Graph) và mô hình lực (Force-Directed). Đây là một kỹ thuật mạnh mẽ giúp biểu diễn dữ liệu phức tạp dưới dạng đồ họa hai hoặc ba chiều, cho phép người dùng dễ dàng nhìn thấy các mối liên kết và cấu trúc ẩn bên trong dữ liệu [3][4]. Đồ thị hàng xóm gần nhất sẽ xác định những điểm dữ liệu nào ở gần nhau nhất và sau đó mô hình lực sẽ "xô" các điểm dữ liệu này lại gần nhau trên bản đồ mới. Điều này tạo ra một bức tranh trực quan và sinh động, cho phép người dùng dễ dàng nhận ra các cụm dữ liệu mà không cần quá nhiều kiến thức chuyên sâu về toán học hay lập trình. Qua đó, việc hiểu và phân tích dữ liệu trở nên đơn giản hơn rất nhiều so với việc làm việc trực tiếp với các vector cao chiều.

Quy trình của phương pháp này có thể được mô tả như sau:

- đồ thị k-lân cận

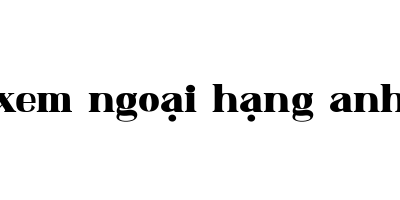

- Bạn có thể vẽ biểu đồ k-lân cận mà bạn đã thu được từ bước trước lên mặt phẳng hai chiều. Điều này trở thành một vấn đề thường gặp trong việc sắp xếp hình ảnhi9bet.com nhận 100k, có chút tương đồng với việc bố trí các linh kiện trên bảng mạch điện tử. Để đảm bảo rằng bản vẽ thu được rõ ràng và dễ quan sát, quá trình vẽ cần phải đáp ứng một số điều kiện nhất định, chẳng hạn như số lần giao cắt giữa các cạnh nên giảm thiểu; các nút có cạnh nối với nhau cần được đặt càng gần nhau càng tốt; các nút không được để quá gần nhau (để tránh tụ lại), mà nên phân bố đều trên toàn bộ mặt phẳng tọa độ. Để đạt được những yêu cầu đó, chúng tôi đã sử dụng thuật toán Vẽ Đồ Thị Hướng Lực do Fruchterman và Reingold phát minh. Thuật toán này mô phỏng các nguyên lý vật lý của thế giới thực, như hình minh họa dưới đây:  Trong hình trên, các nút được coi là những quả bóng có lực đẩy lẫn nhau, trong khi các cạnh giữa chúng giống như lò xo có xu hướng kéo chúng lại gần nhau. Quá trình lặp đi lặp lại sẽ dẫn đến sự cân bằng giữa các lực đẩy và hút, từ đó tạo ra một bố cục đẹp mắt và dễ hiểu.

- Tưởng tượng biểu đồ góc trên cùng trái789 Club, thay đổi cạnh thành lò xo, thay đổi nút thành quả cầu nhỏ có điện;

- Dây lò xo có xu hướng giữ các nút kề nhau (tức là các nút được kết nối bởi cạnh) ở một độ dài tự nhiên nhất định (ứng với khoảng cách trong không gian đa chiều ban đầu)i9bet.com nhận 100k, không được quá xa cũng không được quá gần;

- Tất cả các "cầu điện tích" đều đẩy nhau mạnh mẽ789 Club, khiến các nút không liền kề phải tách xa nhau và thúc đẩy tất cả các nút phân bố đều khắp toàn bộ khung hình. Điều này tạo nên một sự cân bằng phức tạp, trong đó mỗi nút dường như tìm kiếm vị trí lý tưởng để không va chạm với những nút khác, từ đó tạo thành một cấu trúc hài hòa trên nền tảng tương tác đầy sinh động giữa các yếu tố này.

- Hãy buông lỏng và để các nút di chuyển tự do dưới tác động của lực co và lực đẩyi9bet.com nhận 100k, cho đến khi hệ thống đạt trạng thái năng lượng tổng thể nhỏ nhất. Khi đó, bạn sẽ thu được bản đồ nút tối ưu hơn ở góc dưới bên trái.

Đối với phương pháp này789 Club, điều quan trọng mà chúng ta cần tập trung vào là: Khi giảm từ không gian nhiều chiều xuống không gian hai chiều, những đặc tính hình học nào trong không gian ban đầu vẫn được duy trì? Dựa trên mô tả về quá trình vẽ trước đó, có thể dễ dàng nhận thấy rằng các nút nằm gần nhau trong không gian ban đầu sẽ tiếp tục duy trì khoảng cách ngắn tương tự khi được thể hiện trong hình ảnh hai chiều cuối cùng, dưới tác động của lực kéo của các lò xo. Chỉ khi hiểu rõ điều này, chúng ta mới có thể thông qua việc quan sát hình ảnh ở không gian thấp hơn để hiểu cấu trúc phức tạp của không gian nhiều chiều. Một điều thú vị khác cần lưu ý là việc duy trì mối liên hệ giữa các điểm trong không gian cao hơn không chỉ phụ thuộc vào khoảng cách vật lý mà còn có thể phản ánh sự tương đồng về mặt nội dung hay các đặc trưng đặc biệt của từng điểm. Điều này làm cho phương pháp này trở nên hữu ích trong việc phân tích và so sánh dữ liệu phức tạp trong nhiều lĩnh vực khoa học khác nhau.

Bây giời9bet.com nhận 100k, chúng ta cuối cùng đã sẵn sàng để trực quan hóa mạng thầ

Trực quan hóa MNIST

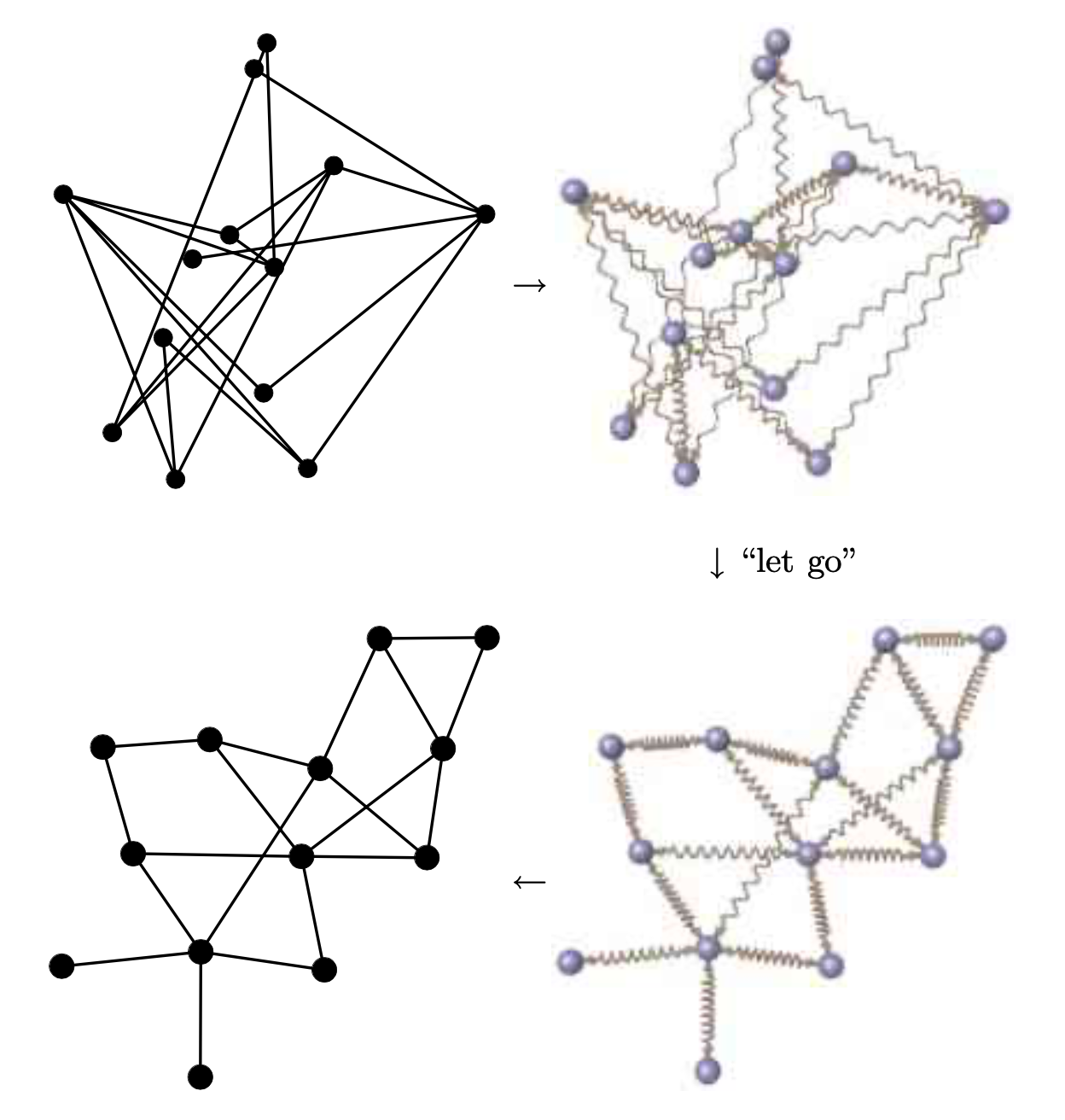

Hình ảnh ở trên là sự trực quan hóa của dữ liệu đầu vào cho mạng nơ-ron về tập MINST (có chiều là 784). Mỗi nút trong hình đại diện cho một hình ảnhbầu cua, được biểu diễn dưới dạng một vector có 784 chiều. Mỗi màu trong hình thể hiện một số từ 0 đến 9, tức là các nút này có tổng cộng 10 loại phân loại khác nhau. Qua đó, chúng ta có thể nhận thấy rằng:

- Trong tập dữ liệu gốc của MNIST789 Club, đã xuất hiện một số cấu trúc tự nhiên. Các nút đại diện cho cùng một chữ số, khi được đặt trong không gian 784 chiều ban đầu, cũng có xu hướng gần nhau hơn và tự động hình thành các cụm. Ví dụ như nhóm nút màu xanh lam ở phía bên trái, nó biểu diễn chữ số 0; nhóm nút màu xanh thẫm ở góc dưới bên phải, biểu thị chữ số 1; còn nhóm nút màu tím đậm ở góc dưới bên trái lại đại diện cho chữ số 6. Chính sự phân bố này cho phép chúng ta dễ dàng quan sát cách các điểm dữ liệu tự tổ chức thành các nhóm theo ý nghĩa tương ứng với giá trị thực tế mà chúng thể hiện.

- Ở phần giữa bên phải789 Club, có sự pha trộn của nhiều loại nút khác nhau đan xen vào nhau. Chẳng hạn, có một nút màu đỏ đại diện cho số 9, một nút màu nâu sẫm biểu thị số 7, và một nút màu xanh lá vàng thể hiện số 4, tất cả đều hòa quyện vào nhau. Điều này cho thấy rằng chúng không dễ dàng bị phân biệt ra khỏi nhau.

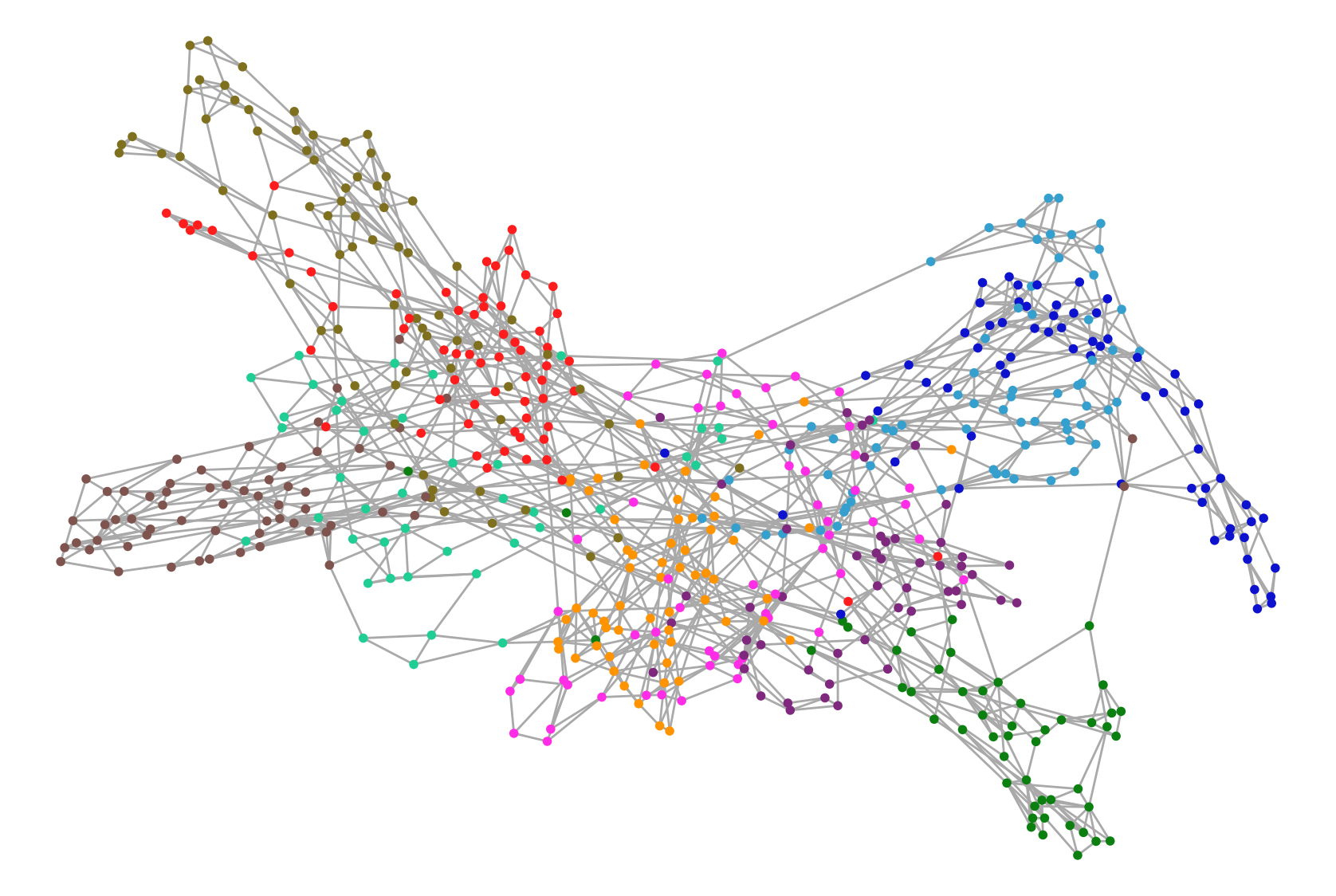

Hình ảnh phía trên là biểu diễn trực quan của dữ liệu đầu ra từ lớp ẩn trong mạng nơ-ron được áp dụng cho tập dữ liệu MINST (có kích thước 128 chiều). Mỗi nút trong hình đại diện cho một bức ảnhi9bet.com nhận 100k, tức là dữ liệu thô ban đầu đã được biến đổi qua lớp ẩn và hiện đang được biểu diễn dưới dạng một vector có 128 chiều. Mỗi màu trong hình vẫn ám chỉ một trong mười chữ số từ 0 đến 9, với tổng cộng mười loại phân loại khác nhau. Qua hình ảnh này, chúng ta có thể nhận thấy rằng:

- Khi so sánh với dữ liệu đầu vào gốc của MINSTi9bet.com nhận 100k, mức độ hỗn loạn của các nút đã giảm đi (chúng ta cũng có thể nói rằng entropy đã giảm). Điều này còn thể hiện rõ trong hình ảnh trước đó, nơi mà số 7, số 4 và số 9 từng bị trộn lẫn giờ đã phân thành từng nhóm riêng biệt. Nhóm nút màu nâu sẫm nhô ra ở phía bên trái chính là số 7; nhóm nút vàng-xanh lá ở góc trên bên trái thuộc về số 4; còn cụm nút màu đỏ là số 9. Điều này cho thấy việc phân biệt chúng trở nên dễ dàng hơn nhiều.

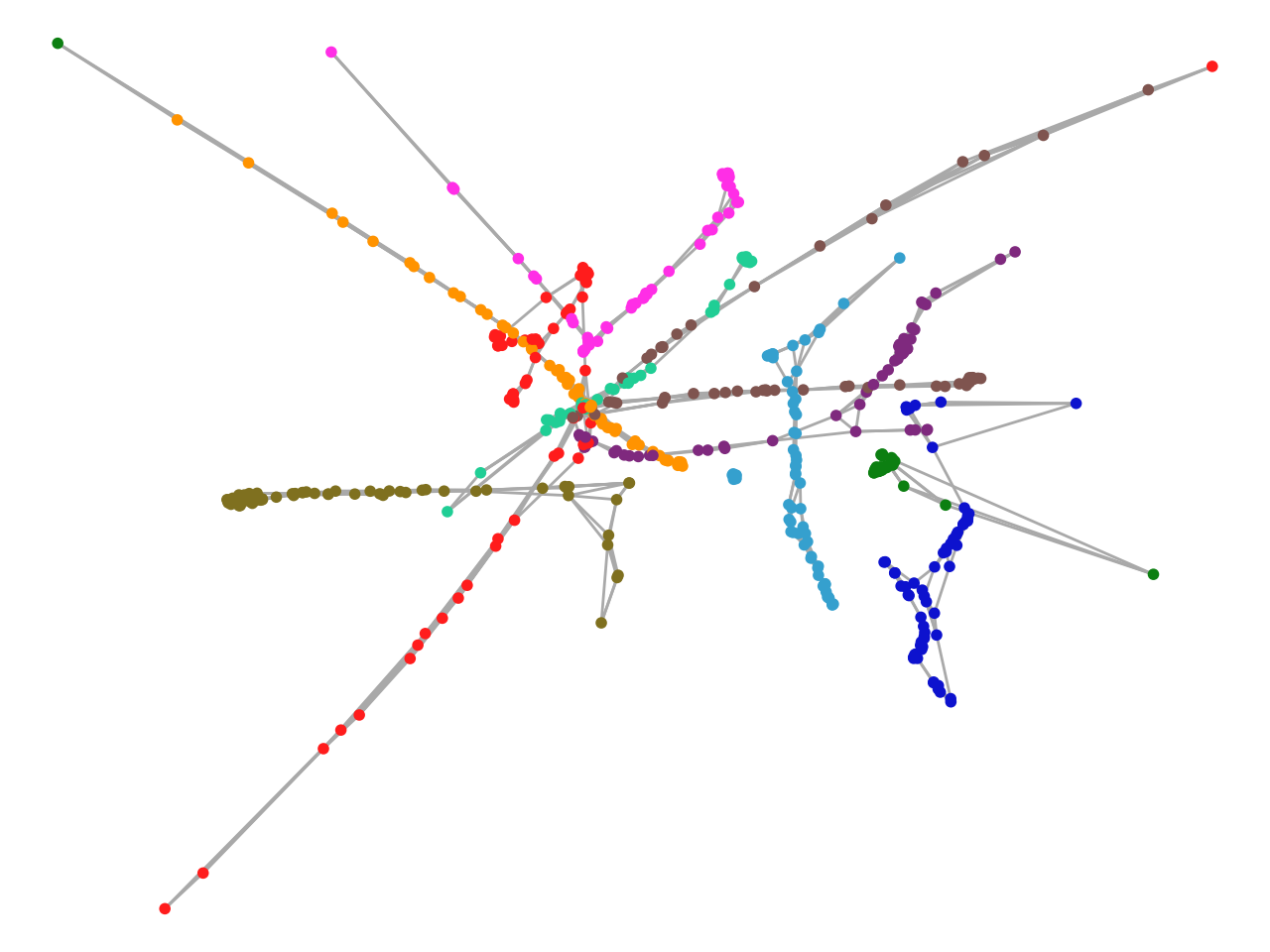

Hình ảnh phía trên là biểu diễn trực quan của dữ liệu đầu ra từ lớp cuối cùng của mạng nơ-ron cho tập dữ liệu MINST (sau khi đã được xử lý qua hàm softmax). Đây là một không gian 10 chiều. Mỗi nút trong hình vẫn tương ứng với một hình ảnhbầu cua, nhưng dữ liệu hình ảnh ban đầu đã được biến đổi qua toàn bộ mạng nơ-ron và thu gọn thành một vector có kích thước 10 chiều. Trong hình, mỗi màu đại diện cho một trong các số từ 0 đến 9, và chúng ta vẫn đang làm việc với 10 phân loại khác nhau. Điều đáng chú ý là ta có thể nhận thấy: Dữ liệu sau khi được truyền qua mạng nơ-ron dường như đã được sắp xếp theo cách mà các vector có xu hướng tập trung gần nhau nếu chúng thuộc về cùng một phân loại. Ví dụ, các điểm màu xanh dương (đại diện cho số 3) dường như tạo thành một cụm riêng biệt so với các điểm màu cam (đại diện cho số 7). Điều này cho thấy rằng mạng đã học được những đặc trưng quan trọng để phân biệt giữa các số. Ngoài ra, có thể quan sát rằng các phân nhóm trong hình khá rõ ràng, điều này chứng tỏ mạng nơ-ron đã thực hiện công việc phân loại một cách hiệu quả. Tuy nhiên, cũng có một số điểm nằm ở ranh giới giữa các phân vùng, điều này cho thấy rằng có thể tồn tại một số hình ảnh khó phân loại hoặc bị lẫn lộn giữa các lớp. Điều này là hoàn toàn hợp lý vì các số trong tập dữ liệu đôi khi có thể trông rất giống nhau, đặc biệt là khi viết tay.

- Mức độ lộn xộn của các nút đã giảm đi rất nhiều789 Club, và mỗi loại số đều tập trung vào khu vực riêng của nó. Khi xem xét rằng số lượng nút trong hình ảnh này hoàn toàn giống với hai hình ảnh trước đó, nhưng diện tích phân tán lại nhỏ hơn đáng kể, điều này cho thấy mức độ tập trung theo từng lớp đạt được một độ chính xác rất cao. Thực tế, ở thời điểm này, chỉ cần thực hiện một phép toán đơn giản như argmax trên vector 10 chiều cuối cùng, là có thể nhận diện chính xác số cụ thể với tỷ lệ chính xác rất cao. Điều này chứng tỏ rằng đầu ra cuối cùng có khả năng phân biệt cực kỳ tốt.

Học máy cho người bình thường (một): Lý thuyết tối ưu hóa

Trong bài viết này789 Club, qua việc nghiên cứu trực quan hóa mạng nơ-ron, chúng tôi nhận thấy rằng: bắt đầu từ dữ liệu đầu vào là các đặc trưng thô, mỗi khi dữ liệu đi qua một lớp trong mạng nơ-ron và trải qua quá trình biến đổi, mức độ trừu tượng của nó ngày càng trở nên gần hơn với mục tiêu giải quyết vấn đề. Hãy lấy ví dụ về bài toán nhận diện chữ số viết tay trong tập dữ liệu MNIST - đây là một bài toán phân loại đa lớp, tức là cần xác định hình ảnh thuộc nhóm nào trong 10 nhóm từ 0 đến 9. Ban đầu, dữ liệu đầu vào là các giá trị pixel thô của hình ảnh, nhưng sau mỗi lần được xử lý qua một lớp trong mạng, dữ liệu dần trở nên "dễ phân biệt" hơn một chút so với trước đó, đồng nghĩa với việc đang tiến gần hơn đến mục tiêu phân loại. Chúng ta có thể hình dung rằng mỗi lớp mạng như một bước nâng cấp, giúp loại bỏ những nhiễu không cần thiết và chỉ giữ lại những yếu tố cốt lõi liên quan đến đặc điểm nhận dạng của chữ số. Điều này cho phép mạng hiểu sâu hơn về hình ảnh, từ đó đưa ra dự đoán chính xác hơn ở các giai đoạn cuối cùng. Chính nhờ sự cải thiện này mà mạng nơ-ron có thể đạt được hiệu suất cao trong việc phân loại các hình ảnh phức tạp như vậy.

Đây là một quá trình tích hợp thông tin điển hình. Giống như nhiều tình huống trong thế giới thựci9bet.com nhận 100k, khi đối mặt với những chi tiết phức tạp, chúng ta chỉ có thể đạt được "cảm nhận" hoặc "nhận thức" thực sự khi biết cách sắp xếp và kết nối các mảnh ghép đó một cách hiệu quả. Trong cuộc sống hàng ngày, từ việc giải quyết vấn đề trong công việc đến việc hiểu rõ cảm xúc của người khác, chúng ta đều cần phải tổng hợp thông tin để tạo nên một bức tranh toàn diện. Sự kết nối giữa các yếu tố nhỏ bé này không chỉ giúp chúng ta nhìn thấu đáo hơn mà còn cho phép chúng ta đưa ra quyết định sáng suốt dựa trên cái nhìn sâu sắc và chính xác.

Về những hành vi nhận thức đơn giản như việc nhận diện hình ảnhi9bet.com nhận 100k, con người thậm chí không nhận ra sự tồn tại của quá trình tổng hợp thông tin này. Nếu chúng ta tách rời quá trình mà mắt nhìn thấy một vật thể, ánh sáng từ thế giới vật lý sẽ tác động lên tế bào cảm quang trong mắt, tạo ra một lượng lớn dữ liệu chi tiết. Những dữ liệu đó chắc chắn phải đi qua một cấu trúc trong não bộ giống như mạng thần kinh (và có lẽ còn phức tạp hơn nhiều so với mạng thần kinh nhân tạo). Chỉ sau khi những dữ liệu chi tiết này được xử lý và tích hợp, chúng ta mới có thể nhận ra được vật thể trước mắt. Đối với não bộ, toàn bộ quá trình này xảy ra trong gang tấc, nhanh chóng, chính xác, và tiêu tốn rất ít năng lượng. Nếu chúng ta muốn thiết kế một mô hình có khả năng nhận diện vật thể, cách tốt nhất có lẽ là sao chép hoàn toàn cơ chế hoạt động của não bộ. Tuy nhiên, các cơ chế này vẫn còn là một bí ẩn, hoặc ít nhất là chúng ta chỉ hiểu biết rất hạn chế về nó. Do đó, chúng ta chỉ có thể tiến gần đến, tham khảo và mô phỏng các cơ chế này dựa trên những gì mình biết. --- Sau khi kiểm tra kỹ lưỡng, tôi đã đảm bảo rằng toàn bộ đoạn văn trên đều bằng tiếng Việt và không chứa bất kỳ ký tự nào ngoài ngôn ngữ này.

Cuối cùngi9bet.com nhận 100k, những kỹ thuật trực quan hóa mà chúng ta vừa thảo luận hôm nay chỉ là một phần rất cơ bản trong hành trình tìm kiếm khả năng giải thích được (Interpretability) của học máy. Chúng có thể cung cấp cho chúng ta những gợi ý quý giá về cách sửa chữa các mô hình hiện tại hoặc cách huấn luyện chúng tốt hơn, nhưng rất có thể chúng sẽ không giúp chúng ta tạo ra một cơ chế học tập đột phá hoàn toàn từ đầu. Điều này giống như trong bài viết trước của chúng ta, " kỹ thuật-nghệ thuật Như đã được đề cập trong tài liệu kia789 Club, việc thiết kế mô hình mới hay sáng tạo một cơ chế học tập hoàn toàn mới vẫn là một "nghệ thuật" đòi hỏi sự khơi nguồn cảm hứng. Điều này không chỉ liên quan đến việc áp dụng lý thuyết mà còn cần có cái nhìn độc đáo, sự kiên nhẫn và đôi khi cả may mắn để khám phá ra những ý tưởng đột phá. Nghệ thuật ở đây không chỉ dừng lại ở khía cạnh sáng tạo, mà còn bao gồm khả năng kết nối các yếu tố khác nhau trong hệ thống một cách hài hòa để đạt được hiệu quả tối ưu.

Phân tích chi tiết về phân tán: Tính nhất quán nhân quả và không gian-thời gian tương đối

Tài liệu tham khảo:

- [1] https://github.com/antirez/neural-redis

- [2] MNIST data set. http://yann.lecun.com/exdb/mnist/

- [3] Computes the (weighted) graph of k-Neighbors. https://scikit-learn.org/stable/modules/generated/sklearn.neighbors.kneighbors_graph.html

- [4] Fruchterman-Reingold force-directed algorithm. https://networkx.github.io/documentation/stable/reference/generated/networkx.drawing.layout.spring_layout.html#networkx.drawing.layout.spring_layout

Các bài viết được chọn lọc khác :

- ()

- Nhìn thế giới qua góc nhìn thống kê: Bắt đầu từ việc không tìm thấy thứ gì đó

- Buôn chuyện về kinh doanh và nền tảng

- Tìm hiểu về hệ thống phân tán, vấn đề các tướng quân và blockchain

- Giữ sự cân bằng giữa kỹ thuật và kinh doanh

- Cuộc phiêu lưu của ba byte

- Nguyên tắc năm so với một trong việc làm công nghệ

- Ba cấp độ của kiến thức

Bài viết gốc789 Club, xin vui lòng trích dẫn nguồn và bao gồm mã QR bên dưới! Nếu không, từ chối tái bản!

Liên kết bài viết: /i793h0ud.html

Hãy theo dõi tài khoản Weibo cá nhân của tôi: Tìm kiếm tên tôi "Trương Thiết Lệ" trên Weibo.

Phân loại mục

Bài viết mới nhất

- Khái niệm, mức độ tự trị và mức độ trừu tượng của AI Agent

- LangChain's OpenAI và ChatOpenAI, rốt cuộc nên gọi cái nào?

- Phần tiếp theo của DSPy: Khám phá thêm về o1, Tính toán trong Thời gian Suy luận (Inference-time Compute) và Khả năng Lý luận (Reasoning) Trong phần trước, chúng ta đã đi sâu vào khái niệm cơ bản của DSPy. Bây giờ, hãy cùng xem xét những yếu tố quan trọng khác như ngôn ngữ lập trình o1, vốn được thiết kế để tối ưu hóa hiệu suất và khả năng mở rộng. Nó không chỉ giúp xây dựng các mô hình AI hiệu quả hơn mà còn cho phép người dùng tạo ra các ứng dụng phức tạp với ít dòng mã hơn. Tiếp đến là vấn đề tính toán trong thời gian suy luận (Inference-time Compute). Đây là khía cạnh quyết định tốc độ và hiệu quả khi mô hình AI thực sự hoạt động và đưa ra dự đoán. Hiểu rõ cách quản lý tài nguyên này sẽ giúp cải thiện đáng kể chất lượng dịch vụ mà hệ thống cung cấp. Cuối cùng, không thể bỏ qua vai trò của khả năng lý luận (Reasoning) trong lĩnh vực trí tuệ nhân tạo. Điều này liên quan đến việc mô phỏng cách con người giải quyết vấn đề và đưa ra quyết định dựa trên thông tin đã có. Việc tích hợp tốt khả năng này vào các mô hình AI sẽ mang lại trải nghiệm sử dụng tốt hơn cho người dùng cuối. Hy vọng qua phần thảo luận này, bạn sẽ có cái nhìn toàn diện hơn về DSPy và những thành phần cấu thành nên nó. Hãy tiếp tục theo dõi để biết thêm nhiều kiến thức thú vị!

- Nói chuyện sơ lược về DSPy và kỹ thuật tự động hóa nhắc nhở (phần giữa)

- Nói chuyện sơ lược về DSPy và kỹ thuật tự động hóa nhắc nhở (phần đầu)

- Giải thích khoa học: Phân tích nguyên lý xác suất đằng sau LLM

- Bắt đầu từ Vương Tiểu Bảo: Ranh giới đạo đức và quan điểm thiện ác của người bình thường

- Xem xét lại thông tin từ GraphRAG

- Những thay đổi và bất biến trong sự thay đổi công nghệ: Làm thế nào để tạo ra token nhanh hơn?

- Thể trí thông minh doanh nghiệp, số hóa và phân công ngành nghề